はじめに

米・MITの研究チームがニューラルネットワークベースのAIを利用した意思決定の不確実性(AIが導き出した答えの信頼度)を迅速に推定する方法を提案しました。

A neural network learns when it should not be trusted

https://news.mit.edu/2020/neural-network-uncertainty-1120

論文

Deep Evidential Regression

http://www.mit.edu/~amini/pubs/pdf/deep-evidential-regression.pdf

概要

現在、ニューラルネットワークは現実の世界ですでに利用されておりかなり高い精度を誇っていますが、ネットワークが導き出した答えが常に正しいわけではありません。ネットワークが出す答えの確実性の段階には、自動運転車であれば「交差点を通過しても全く問題ない」と「おそらく問題ないが念のために停止する必要がある」というレベルの差が存在する可能性があります。

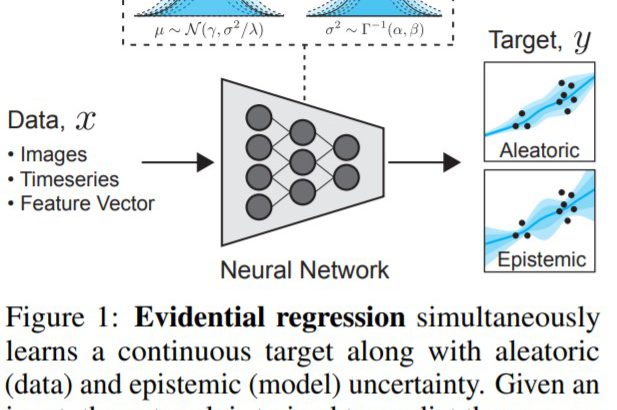

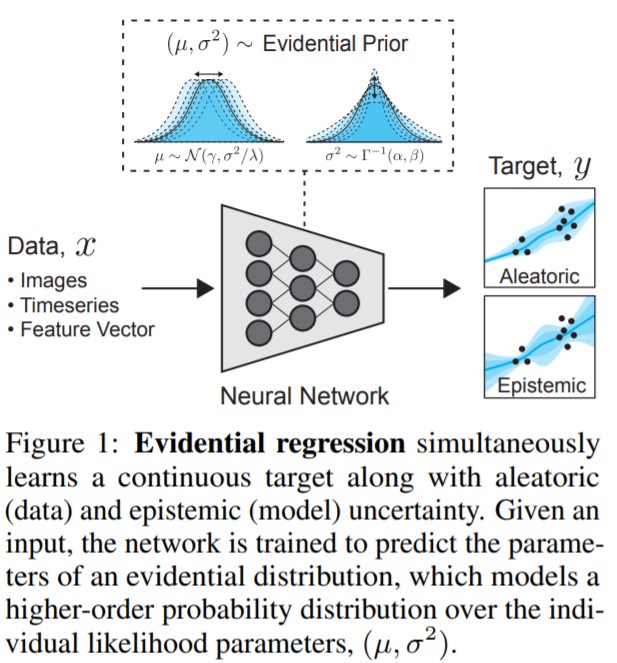

しかし、一般にニューラルネットワークの不確実性(信頼度)の推定における計算コストは高く、瞬間的な決定を求められる場面では決定を出すまでに時間がかかりすぎます。今回、「深層証拠回帰(deep evidential regression)」と呼ばれるアプローチをMITが提唱しました。

詳細

ニューラルネットワークは高い精度を誇りますが、それでも100%と正しいわけではなく、場合によっては間違った判断を下してしまいます。そして、問題はモデルがいつ間違ってしまうのか(いつ間違っているのか)を瞬時に知ることが難しいということにあります。

これまでも、ニューラルネットワークの不確実性に関する研究は行われてきました。しかし、ベイジアンディープラーニングに由来する従来のアプローチは、その不確実性(信頼性)を知るために、ニューラルネットワークを何度も実行またはサンプリングする必要があり、結果として時間とメモリが潤沢にある場合には問題ありませんが、限られた資源と時間のなかでは問題となります。

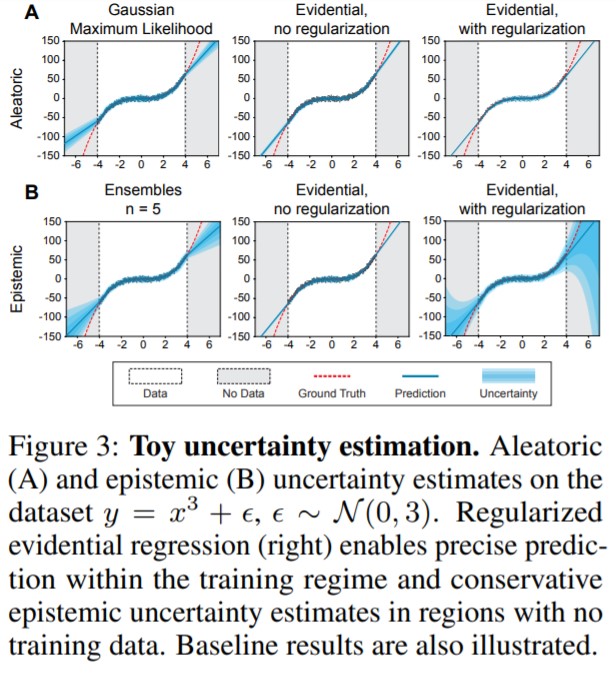

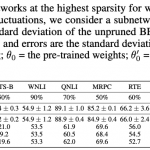

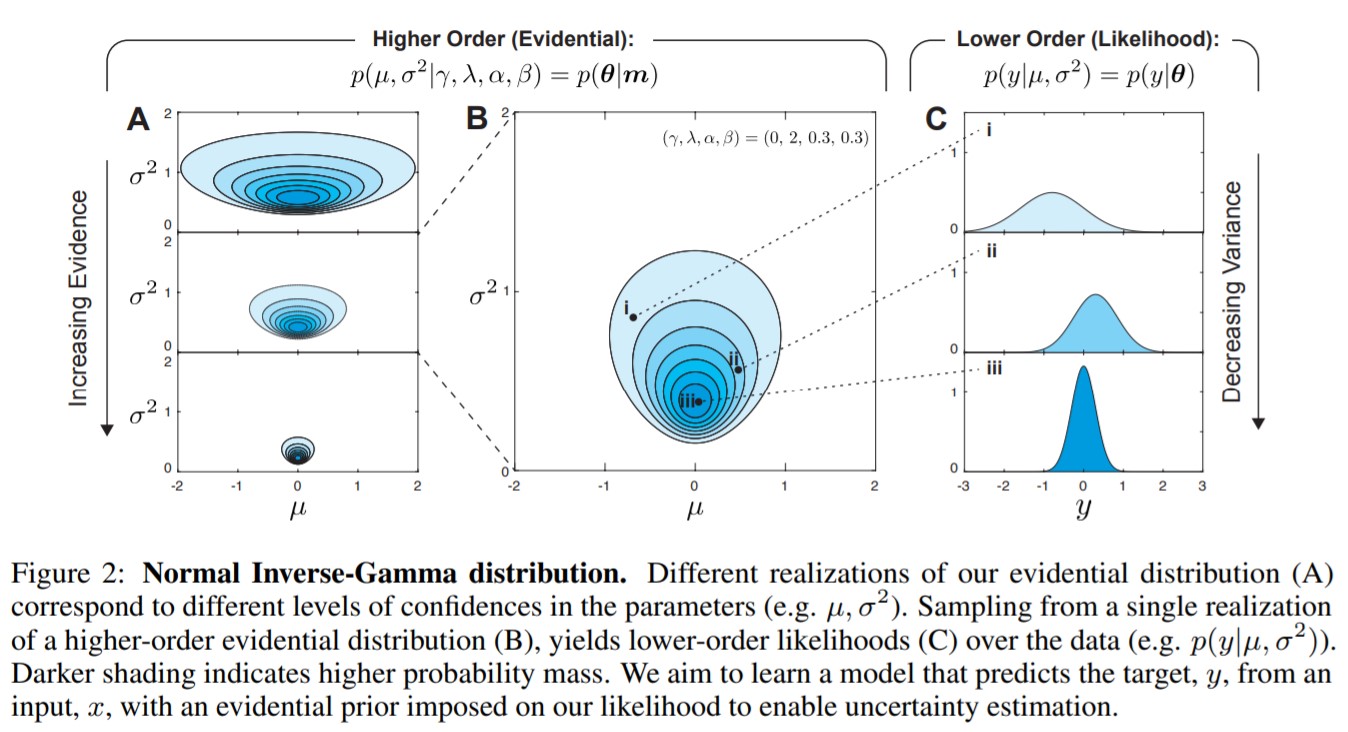

今回の研究では、ニューラルネットワークを1回だけ実行した結果から、不確実性を推定する方法が考案されました。大量の出力を使用してネットワークを設計し、決定だけでなく、その決定をサポートする証拠を取得する新しい確率分布も生成します。証拠分布(evidential distributions)と呼ばれるこれらの分布は、モデルの予測に対する信頼度を直接獲得することができます。この分布には、基礎となる入力データおよびモデルの最終決定に存在する不確実性が含まれます。

〇実験

研究チームは、ネットワークが学習の「分布外」データを判断する際に、「不確実性」のスコアを高めることを示しました。(例えば、研究チームは屋内の画像でネットワークをトレーニングした後、屋外の運転シーンをネットワークに供給しました。その際、ネットワークは一貫して、屋外シーンに対する判断が不確実であると警告しました。)

別の実験では、研究者はネットワークに供給する画像のバッチで敵対的なノイズを挿入しました。その影響は微妙で、人間の目にはほとんど知覚できませんが、ネットワークはそれらの画像のノイズに反応し、その出力に高レベルの不確実性を付与しました。改ざんされたデータに警告を発することができるこの機能は、現在ニューラルネットワークに対して行われる敵対的攻撃を検出して阻止するのに役立つ可能性があることが指摘されています。]