はじめに

Facebookがソルボンヌ大学と共同でContinual Learning(継続学習モデル)に関する新しいベンチマークを発表しました。

https://ai.facebook.com/blog/ctrl-and-mntdp-a-new-open-source-benchmark-and-model-for-continual-learning/

論文

Efficient Continual Learning with Modular Networks and Task-Driven Priors

https://arxiv.org/pdf/2012.12631.pdf

概要

Continual Learning(継続学習)モデルとは、機械学習で新たな知識(タスク)を学習する際に、それ以前に学習、習得した知識を再利用することでより効率的で精度の高い学習を可能にするモデルのことです。人間は以前の知識を利用して新たなタスクを効率的に行うことができることに着目しており、継続的に同一モデルが学習することでより効率的に学習することが目指されています。

今回、FacebookがCLモデル向けに、新たなベンチマークテストを発表しました。CLモデルを利用することで、教師データが少なくて済み、最新のAIシステムの最も重要な欠点の1つである人間がラベル付けした大規模なデータセットへの依存を回避できることが期待されています。

開発の背景

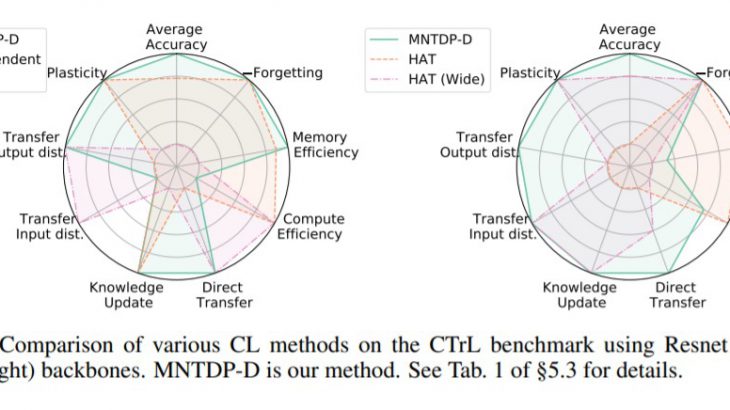

CLモデルは、人間が以前の知識などを下地にして新たなタスクに挑むことができることを機械学習に模倣しようとしている挑戦的な機械学習モデルです。モデルを評価するうえでは、1)タスク間で知識をどれだけうまく伝達するか、2)以前に学んだスキルを保持する能力(いわゆる壊滅的な忘却の問題を回避する)、3)非常に多くのタスクにどのように拡張するか、などの観点が必要ですが、これまでこれらの軸全体でCLシステムを評価するための効果的な標準ベンチマークはありませんでした。

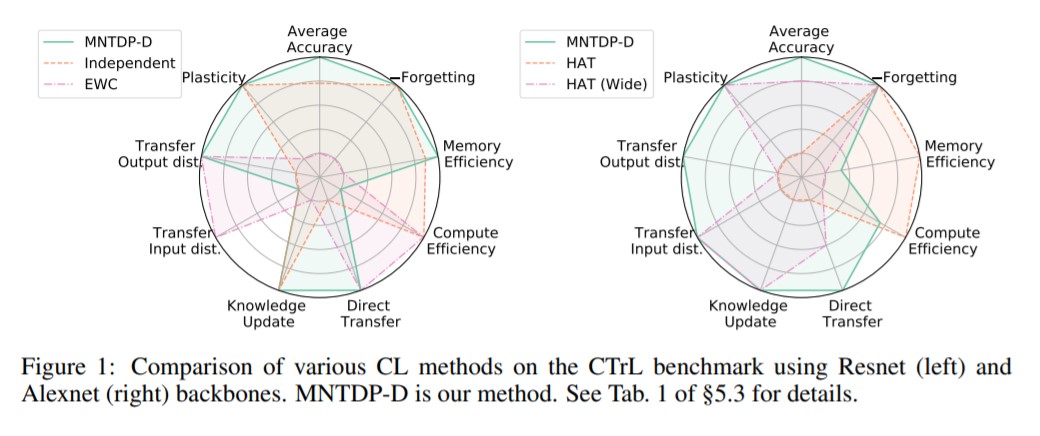

今回、Facebookはソルボンヌ大学と共同で、効果的なCLモデルと、その全体システムを評価するための『CTrL』とよばれる標準ベンチマークを作成しました。またさらに、独自のベンチマークを含むさまざまなベンチマークで優れたパフォーマンスを提供する新しいCLモデルMNTDPをオープンソース化しました。

CTrL

主たる貢献は、効果的なCLモデルが必要とする一般的な特性を特定することです。モデルのメモリ消費量はタスクが追加されるにつれてゆっくりと増加することや、以前に取り組んだタスクに関連する新しい例を観察するときにより正確な予測を行うことなどです。

CTrLは、2つの条件で同じタスクのモデルのパフォーマンスを比較するという考えに基づいています。(タスクが単独で学習された場合と、関連する可能性のある一連のタスクの観察後に学習された場合を比較します。)CTrLは、両方の設定でモデルを調べることにより、一連の観察されたタスクから転送された知識の量を評価するのに役立ちます。これにより、同様のタスクに転送するモデルの機能を正常に評価できます。ベンチマークは、転送の複数の次元を評価するための多数のタスクストリームと、CLモデルのスケーリング能力を評価するための一連の長いタスクを提案しています。

CTrLの公式説明動画

https://ai.facebook.com/1319742961447503/videos/106129528087784/

MNTDP

MNTDP(Modular Networks with Task-Driven Priors)は、新たに開発されたCLモデルです。このモデルでは、以前に学習したどのモジュールを適用できるか、およびタスクを解決するためにどの新しいモジュールが必要かを決定します。現在のタスクが前のタスクに類似しているほど、MNTDPはモジュールを共有します。MNTDPは、モジュールを組み合わせるための可能な方法で検索スペースを制限するために使用されるタスク駆動型の事前情報を活用します。これにより、計算が大幅に削減され、転送品質が向上します。

MNTDPの公式説明動画

https://ai.facebook.com/1319742961447503/videos/753686462242079/

まとめ

CLは挑戦的な分野であり、安定的に実装できるようになれば現在のMLモデルが抱えている多くの問題を解決することができます。まだ、このCL分野は初期段階であり、今後の発展が大いに期待されます。